Deepfake: quando l’intelligenza artificiale è reato

Care lettrici e cari lettori, questa settimana voglio parlarvi di un argomento davvero importante e più che mai attuale, ovvero il fenomeno del deepfake e la rilevanza che ha nel nostro ordinamento.

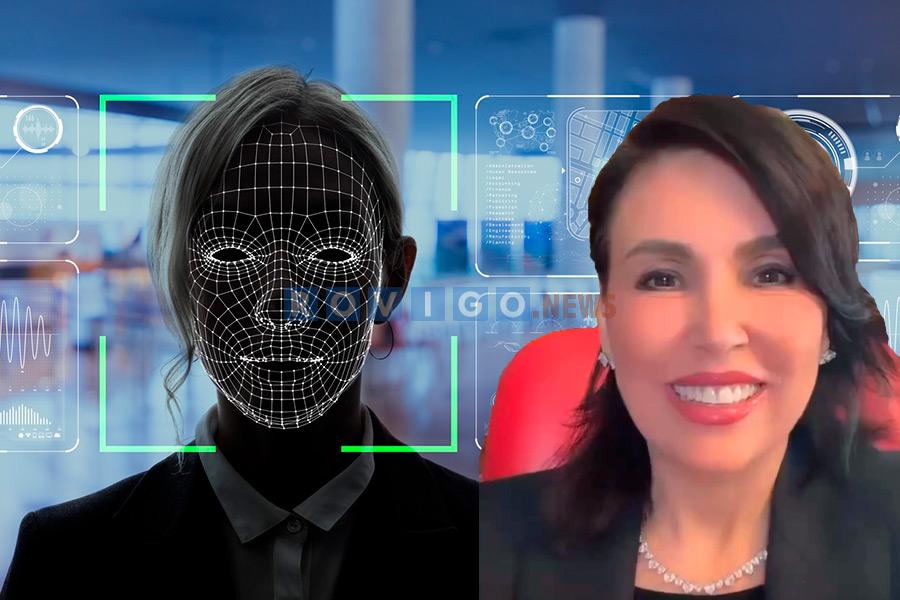

Il dilagante utilizzo di sistemi di intelligenza artificiale generativi ha portato ad una diffusione preoccupante del deepfake, termine con cui si sta ad indicare il fenomeno di creazione – grazie all’intelligenza artificiale – di contenuti multimediali (audio, video, foto, ecc…) capaci di riprodurre con elevato grado di verosimiglianza i tratti somatici, le movenze e persino il timbro vocale di un individuo, fino a creare un vero e proprio “clone” digitale assolutamente realistico.

Seppur recente, il fenomeno ha preso una piega decisamente sconveniente.

Si registra, infatti, un numero sempre più elevato di contenuti falsificati che ritraggono soggetti in situazioni intime, compromettenti o comunque idonee a ledere la loro reputazione personale e professionale.

Questa preoccupante tendenza non ha risparmiato nemmeno personaggi famosi le cui immagini e voci vengono spesso manipolate al fine di creare campagne pubblicitarie di cui i poveri malcapitati si ritrovano ad essere inconsapevoli ambasciatori, attirando milioni di visualizzazioni.

La portata del fenomeno, l’elevato grado di credibilità del deepfake e i pericoli che ne possono derivare hanno reso necessario prevedere una fattispecie di reato ad hoc.

In questa prospettiva, è stato introdotto nel nostro Codice Penale il reato di illecita diffusione di contenuti generati o alterati con sistemi di intelligenza artificiale previsto all’art. 612 quater del Codice Penale.

Questo articolo punisce con la reclusione da uno a cinque anni chiunque cagiona un danno ingiusto ad una persona, cedendo, pubblicando o altrimenti diffondendo, senza il suo consenso, immagini, video o voci falsificati o alterati mediante l’impiego di sistemi di intelligenza artificiale e idonei a indurre in inganno sulla loro genuinità.

Come precisato dalla norma, affinché il fatto sia punibile è necessario, in primo luogo, che il deepfake abbia cagionato un danno ingiusto alla vittima.

Per danno ingiusto si intende non solo il danno patrimoniale ma anche il danno non patrimoniale (come, ad esempio, il turbamento psicologico o lesione della propria reputazione) che il soggetto può subire a causa dei contenuti incriminati.

Non solo.

Il contenuto deve essere stato creato con sistemi di intelligenza artificiale e deve essere idoneo a indurre in inganno i terzi, circostanza che porta ad escludere l’integrazione del delitto in tutti i casi in cui il deepfake sia frutto di un’alterazione o manipolazione grossolana.

Ultimo, ma non certo meno importante, requisito affinché il reato possa dirsi integrato è che il contenuto sia stato creato con sistemi di intelligenza artificiale, nozione a dir poco generica che lascia spazio a non pochi dubbi interpretativi.

Il delitto è punibile a querela della persona offesa ma si procede d’ufficio se il fatto è connesso con altro delitto per il quale si deve procedere d’ufficio ovvero se è commesso nei confronti di persona incapace, per età o per infermità, o di una pubblica autorità a causa delle funzioni esercitate.

COSA NE PENSO IO?

L’introduzione di questa nuova fattispecie di reato rende evidente che il diritto non può restare indifferente di fronte a tecnologie capaci di incidere così profondamente sull’identità e sulla reputazione delle persone.

Resta da chiedersi, però, se il diritto – e così la sua corretta applicazione – possa davvero tenere il passo con il costante sviluppo tecnologico e garantire la tutela dei nostri diritti o se, invece, c’è il rischio che l’intelligenza artificiale sia sempre un passo avanti.

Avv. Fulvia Fois